情報理論で出てくる

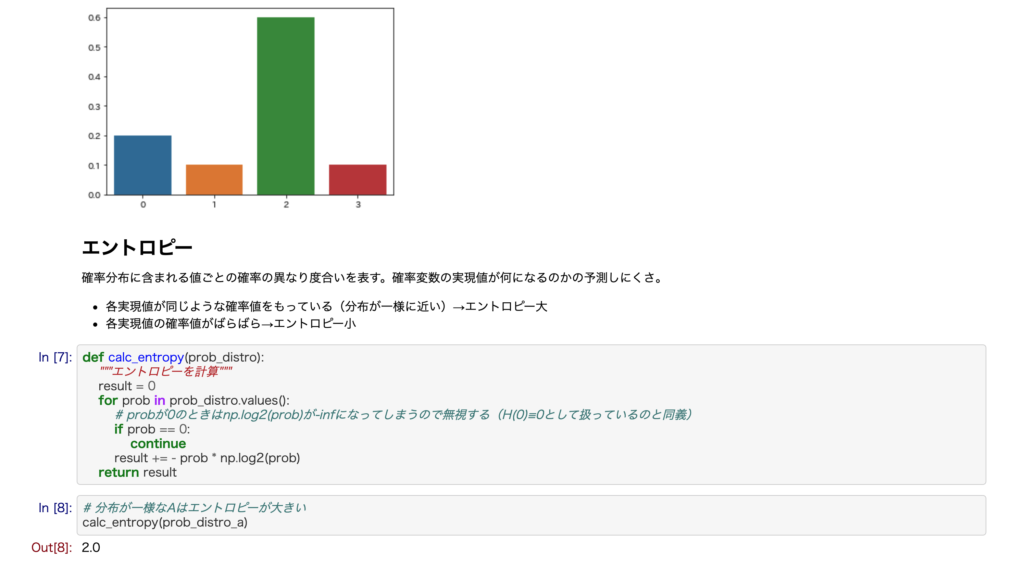

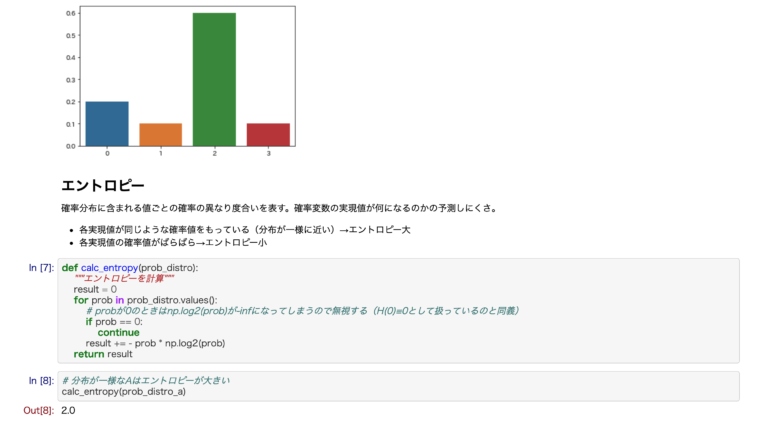

- エントロピー

- KLダイバージェンス

- 交差エントロピー

- 自己相互情報量(PMI)

をPythonで実装しました。

ソースコードはここに載せるにはボリューミーなので、Jupyter notebookで書いてGitHubで公開しています。

study/information_theory/entropy_kl_divergence_cross_entropy_pmi.ipynb at master · mimosom/study

Contribute to mimosom/study development by creating an account on GitHub.

ソースコードはパフォーマンスよりも、やっていることの分かりやすさを重視した書き方を心掛けました。

内容は言語処理のための機械学習入門 (自然言語処理シリーズ)を参考にしました。

この本は、機械学習で使う数学的な基礎知識が一章に簡潔にまとめられていて、とても役立ちます。

自然言語処理における機械学習の利用について理解するため,その基礎的な考え方を伝えることを目的としている。広大な同分野の中から厳選された必須知識が記述されており,論文や解説書を手に取る前にぜひ目を通したい一冊である。

コメント